Mostrar los tags: r

Mostrando del 61 al 70 de 3.127 coincidencias

Se ha buscado por el tag: r

-----------------------------------

Hilario Iglesias Martínez

*************************************

Este es un programa en Python

se realiza una regresión lineal

utilizando el método de gradiente descendente

(Batch Gradient Descent)

El programa realiza una regresión lineal utilizando

el método de gradiente descendente

y visualiza los resultados a través de

gráficas. Es una implementación simple

pero efectiva de un modelo de regresión lineal.

***********************************************

Programa realizado bajo una plataforma Linux:

Ubuntu 20.04.6 LTS.

Editado con: Sublime Text.

*********************************

Ejecución bajo consola Linux.

python3 ParaClaseLunes-Sep-F543.PY

*******************************************

"""*****************************************************************************************************

Hilario Iglesias Martínez

ClaseViernes-F543.py

DESCENSO DE GRADIENTE BATCH

*********************************************************************************************************

El "descenso de gradiente tipo Batch" es una técnica de optimización utilizada en el aprendizaje automático y la estadística para ajustar los parámetros de un modelo matemático, como una regresión lineal o una red neuronal, de manera que se minimice una función de costo específica. Es una de las variantes más simples y fundamentales del descenso de gradiente.

Aquí tienes una explicación de cómo funciona el descenso de gradiente tipo Batch:

Inicialización de parámetros: Comienza con un conjunto inicial de parámetros para tu modelo, que generalmente se eligen de manera aleatoria o se establecen en valores iniciales.

Selección de lote (Batch): En el descenso de gradiente tipo Batch, se divide el conjunto de datos de entrenamiento en lotes o subconjuntos más pequeños. Cada lote contiene un número fijo de ejemplos de entrenamiento. Por ejemplo, si tienes 1000 ejemplos de entrenamiento, puedes dividirlos en lotes de 32 ejemplos cada uno.

Cálculo del gradiente: Para cada lote, calculas el gradiente de la función de costo con respecto a los parámetros del modelo. El gradiente es una medida de cómo cambia la función de costo cuando se hacen pequeños ajustes en los parámetros. Indica la dirección en la que debes moverte para minimizar la función de costo.

Actualización de parámetros: Después de calcular el gradiente para cada lote, promedias los gradientes de todos los lotes y utilizas ese gradiente promedio para actualizar los parámetros del modelo. Esto se hace multiplicando el gradiente promedio por una tasa de aprendizaje (learning rate) y restando ese valor de los parámetros actuales. El learning rate controla el tamaño de los pasos que das en la dirección del gradiente.

Repetición: Los pasos 2-4 se repiten varias veces (llamadas épocas) a través de todo el conjunto de datos de entrenamiento. Cada época consiste en procesar todos los lotes y ajustar los parámetros del modelo.

Convergencia: El proceso de ajuste de parámetros continúa hasta que se alcanza un criterio de convergencia, que generalmente se establece en función de la precisión deseada o el número de épocas.

El descenso de gradiente tipo Batch es eficiente en términos de cómputo, ya que utiliza todos los datos de entrenamiento en cada paso de actualización de parámetros. Sin embargo, puede ser lento en conjuntos de datos grandes, y su convergencia puede ser más lenta en comparación con otras variantes del descenso de gradiente, como el descenso de gradiente estocástico (SGD) o el mini-batch SGD.

En resumen, el descenso de gradiente tipo Batch es una técnica de optimización que ajusta los parámetros de un modelo mediante el cálculo y la actualización de gradientes en lotes de datos de entrenamiento, con el objetivo de minimizar una función de costo. Es una parte fundamental en la optimización de modelos de aprendizaje automático.

*********************************************************************************************************

Ejecucion.

Bajo consola de Linux.

python3 ClaseViernes-F543.py[

b]"""

Hilario Iglesias Martinez.

*****************************************************

seno.py

********************************************************

Descenso de gradiente en una función seno.

----------------------------------------------------------

Función Seno (sin(x)): La función seno es una función trigonométrica

que toma un ángulo como entrada y devuelve la relación entre

la longitud del cateto opuesto a ese ángulo y la longitud de

la hipotenusa en un triángulo rectángulo. En términos más simples,

el valor del seno de un ángulo en un triángulo rectángulo es igual

a la longitud del lado opuesto dividido por la longitud de la hipotenusa.

En el contexto de funciones reales, la función seno asigna un valor

real a un ángulo en radianes. Su gráfica oscila entre -1 y 1,

creando una forma ondulante suave que se repite cada 2π radianes.

--------------------------------------------------------------------[/b]

EJECUCION BAJO CONSOLA LINUX.

python3 seno.py"""

*************************************

parabola.py

**************************************

Hilario Iglesias Martínez.

---------------------------------------

El descenso de gradiente es un algoritmo

que estima numéricamente dónde una función

genera sus valores más bajos.

En este ejemplo lo aplicaremos a la sigiente función:

Función de cálculo

f(x)=x**2/3+3x**2

Derivada

20*x/3

-------------------------------------------------

Programa realizado en una Plataforma Linux.

Ubuntu 20.04.6 LTS.

Editado con Sublime Text.

También se puede editar y ejecutar con:

Google Colab.

---------------------------------------

Ejecución bajo consola linux:

python3 parabola.py

"""Derivada_Descenso_Gradiente_2.py

Que hace el programa:

Dada la parábola de esta función:

f(x)=(x ** 2 / 2)

Vamos a realizar la derivada inversa con regresión a partir

de un punto dado por:

init_x = 18.

También imprimiremos valores intermedios de x e y, y su valor de gradiente mínimo.

****************************************************************

Ejecucion bajo consola Linux.

python3 Derivada_Descenso_Gradiente_2.py

------------------------------------------------------------

Tambien se puede editar y ejecutar con Google Colab."""

Derivada_Descenso_Gradiente.py

-----------------------------------

Que hace el programa:

Dada la parábola de esta función:

f(x,t)=(x ** 2 / 2) + t

Vamos a realizar la derivada de los puntos de una parábola

de forma inversa, lo que se define como descenso de gradiente,

a partir de un punto dado por:

init_x = 18.

Muy utilizado en Redes Neuronales.

También imprimiremos su valor al llegar

a la última vuelta del "loop" range(5000)

------------------------------------------------

Ejecución bajo consola de linux, con este comando:

python3 derivada_descenso_gradiente_1.py

-------------------------------------------------

***************************************************************

Programa Realizado Bajo plataforma Ubuntu

de linix.

Editado con Sublime text.

También se puede editar y ejecutar con Google Colab

*****************************************

"""--------------------------

A fronte praecipitium a tergo lupi.

---------------------------

Hilario Iglesias Martínez.

***************************

f(x,t)=(x**2/3)+t

Valores de predicción ([[8, 12]])

Valor de Salida prediccion:

(8**2/3)+12= 33,333333333

****************************

Realizado en plataforma Linux.

Ubuntu 20.04.6 LTS.

Editado con Google Colab.

"""

**************************

De parvis grandis acervus erit

**************************

NumeroEuler.py

**************************

Hilario Iglesias Martínez.

**************************

Ecuacion para datos de entrada:

f(x,z)=(x**2/4)+(e*z)

e=Número de Euler.

2.71828

Valores de entrada [5,12] La salida real debería ser=38.86936

Realizado bajo plataforma Linux.

Ubuntu 20.04.6 LTS.

Google Colaboratory.

"""

Carpe Diem

--------------------------------------------------------

Hilario Iglesias Martínez

******************************************************

pi.py

*****************************************

Ecuacion inventada de partida para los valores de entrada y salida.

f(x)=(x**2)*π

π=3.141618

prediccion=232.690

valor real=234.127

********************************************************

Se puede jugar con el programa para disminuir el error.

Realizado en un ordenador con Ubuntu 20.04.6 LTS.

Editado en Google Colab.

Tarda en predecir el valor dado aproximadamente 4 mn.

con una velocidad de bajada de 518.1 Mbps

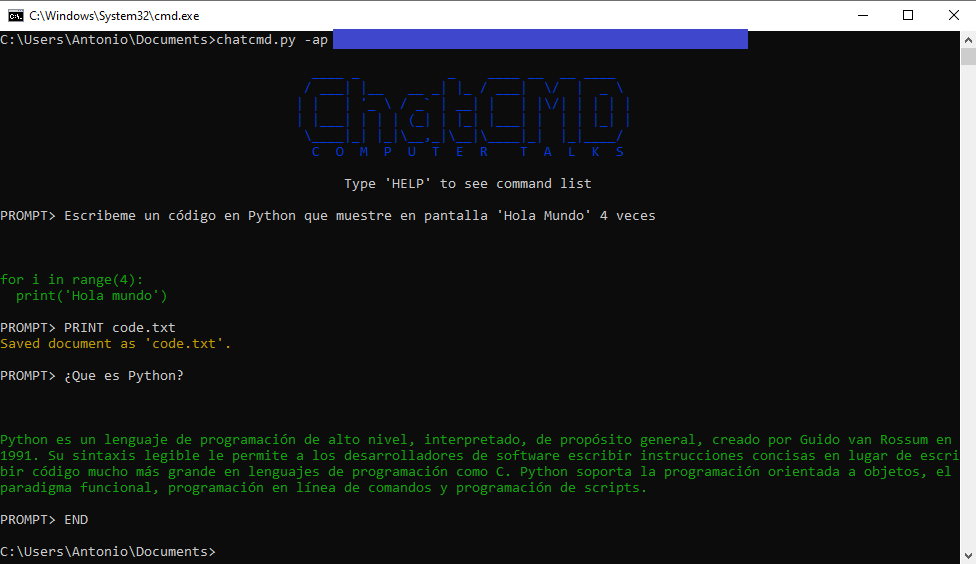

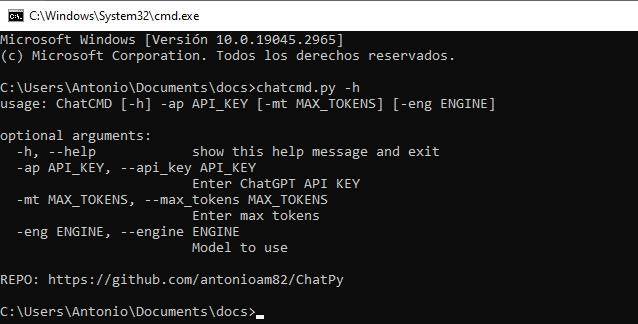

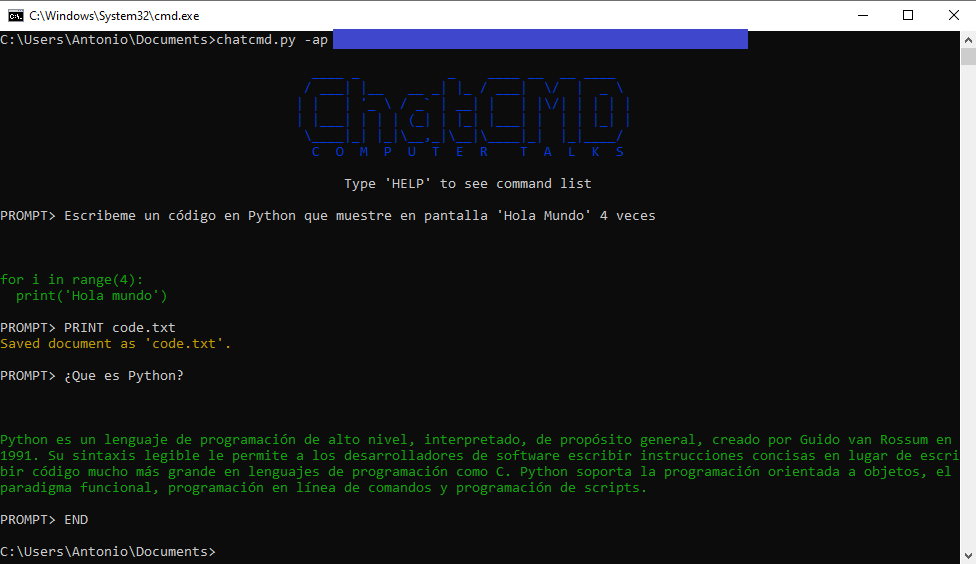

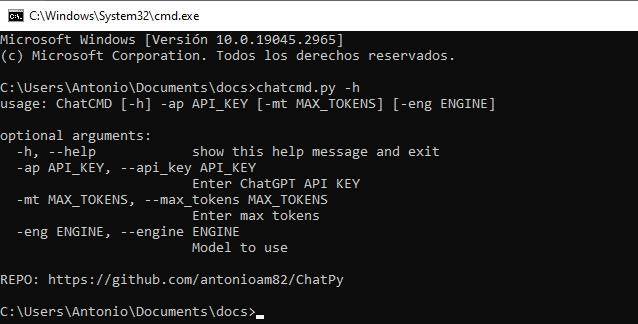

Programa para usar ChatGPT dese la terminal. Al iniciarlo se requiere introducir la Api-Key del usuario.

PARA CUALQUIER DUDA U OBSERVACIÓN, USEN LA SECCIÓN DE COMENTARIOS.